OpenAI, empresa de ChatGPT, presenta una IA capaz de simular mundos

OpenAI presentó la herramienta Sora que puede crear videos realistas a partir de texto con instrucciones sobre el video. Este es el lanzamiento más importante de la compañía desde ChatGPT y GPT 4.

Durante el año pasado, la empresa de inteligencia artificial OpenAI se hizo conocida en todo el mundo gracias a la popularidad de ChatGPT. En poco tiempo, ChatGPT se convirtió en la herramienta que más rápido alcanzó el millón de usuarios, superando a Facebook e Instagram. A día de hoy, ChatGPT se utiliza habitualmente debido a su capacidad para crear textos.

Con DALL-E, la empresa ya estaba mostrando avances en el uso de textos para generar imágenes y videos. La idea es una herramienta similar a ChatGPT pero que devuelve imágenes en lugar de textos. El año pasado, DALL-E se implementó en el motor de búsqueda Bing de Microsoft. Microsoft obtuvo los derechos para implementar ChatGPT y DALL-E.

Hace unos días atrás, dieron un paso más en el uso de la inteligencia artificial generativa con la introducción de Sora. Sora es una herramienta que puede crear videos realistas a partir de texto con instrucciones, similar a ChatGPT y DALL-E. En el anuncio, OpenAI afirmó que Sora es capaz de simular mundos físicos de manera realista.

Inteligencia artificial generativa

El área de la inteligencia artificial (IA) es amplia y cuenta con una variedad de técnicas diferentes según la aplicación. En los últimos años ha ganado protagonismo un área denominada inteligencia artificial generativa. La IA generativa corresponde a modelos que se construyen para generar nuevos datos que van desde textos hasta videos.

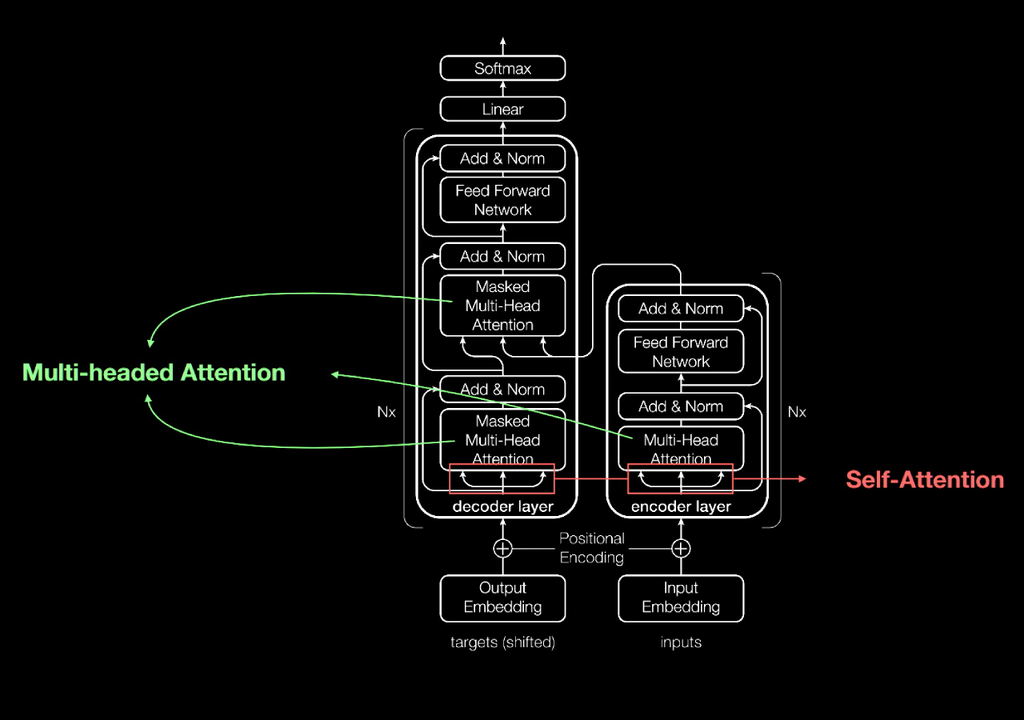

La IA generativa comenzó a ganar popularidad en 2014 cuando el científico Ian Goodfellow introdujo las redes neuronales generativas (o GAN, por su sigla en inglés). Las GAN utilizaron técnicas de teoría de juegos para generar nuevas imágenes a partir de ruidos. El gran avance se produjo cuando Google introdujo un nuevo tipo de arquitectura llamada Transformers.

T de Transformers

Si piensas en lo que significa la T en GPT, es por la técnica que se utilizó para construir estos modelos: los transformers. Son un tipo de arquitectura que se introdujo en 2017. El uso original de los transformers o transformadores fue en aplicaciones de procesamiento de lenguaje natural.

Lo que caracteriza a un transformador radica en una capa llamada atención o mecanismo de atención. Esta capa utiliza herramientas matemáticas que hacen que la función preste atención a diferentes regiones de los datos. Con esta capa, el modelo puede realizar tareas basadas en las partes más importantes.

Además, los transformadores se construyeron para manejar secuencias. Una frase es una secuencia de palabras que tiene relaciones que pueden ser complejas. Los transformadores pueden comprender la relación entre las palabras de una frase u oración. Posteriormente, la aplicación de los transformadores fue a secuencias temporales o secuencias de píxeles que forman imágenes.

Genera textos, imágenes y vídeos

En los últimos años, varias empresas e investigadores se han centrado en el uso de transformadores para la inteligencia artificial generativa. La capacidad de aprender arquitecturas utilizando transformadores ha demostrado tener un gran potencial. No pasó mucho tiempo para que se crearan herramientas públicas basadas en transformadores.

La más famosa de estas herramientas es ChatGPT, que fue introducida por OpenAI. ChatGPT utiliza transformador en su arquitectura y es un modelo conocido como text-to-text, es decir, de texto a texto. Sin embargo, pronto OpenAI presentó DALL-E, que también funciona con transformadores y es del tipo text-to-image. Ahora, Sora aparece como una herramienta de conversión de text-to-video.

Sora

Según OpenAI, Sora es un modelo al que se le enseñó a comprender y simular el mundo físico a través de vídeos. Sora puede generar vídeos de hasta 1 minuto que son extremadamente realistas basándose simplemente en un texto con instrucciones de entrada. En la página oficial del proyecto han sido puestos como ejemplo varios videos creados por el modelo.

Introducing Sora, our text-to-video model.

— OpenAI (@OpenAI) February 15, 2024

Sora can create videos of up to 60 seconds featuring highly detailed scenes, complex camera motion, and multiple characters with vibrant emotions. https://t.co/7j2JN27M3W

Prompt: Beautiful, snowy pic.twitter.com/ruTEWn87vf

En su página, OpenAI sostiene que el modelo es capaz de generar escenas complejas con múltiples personajes, tipos específicos de movimiento y detalles precisos del sujeto y del fondo. Además, otra ventaja es que el modelo puede crear escenas considerando el entorno y cómo las cosas existen en el mundo físico.

Creando mundos

La empresa se refiere al modelo como un “simulador mundial”, ya que presenta la capacidad de comprender el mundo físico y tridimensional. El modelo puede crear, basándose en esta comprensión, otras versiones de este mundo dadas instrucciones de texto como entrada. Sin embargo, OpenAI admite que Sora aún se encuentra en fase de prueba y tiene limitaciones.

Algunas de las limitaciones están asociadas, por ejemplo, a aspectos espaciales confusos. Si describe cómo se desea que la cámara cree imágenes, es posible que Sora tenga dificultades para comprender la posición. Un error que se volvió viral fue que Sora creó una silla de plástico como si fuera arena en un video imitando a los arqueólogos excavando.

No te pierdas la última hora de Meteored y disfruta de todos nuestros contenidos en Google Discover totalmente GRATIS

+ Seguir a Meteored