Los algoritmos te hacen creer que sabes más de lo que realmente conoces, según nuevo estudio

Los algoritmos de recomendación que deciden qué ves en redes sociales y plataformas digitales pueden estar engañando a tu cerebro: te hacen creer que dominas temas sobre los que apenas sabes nada.

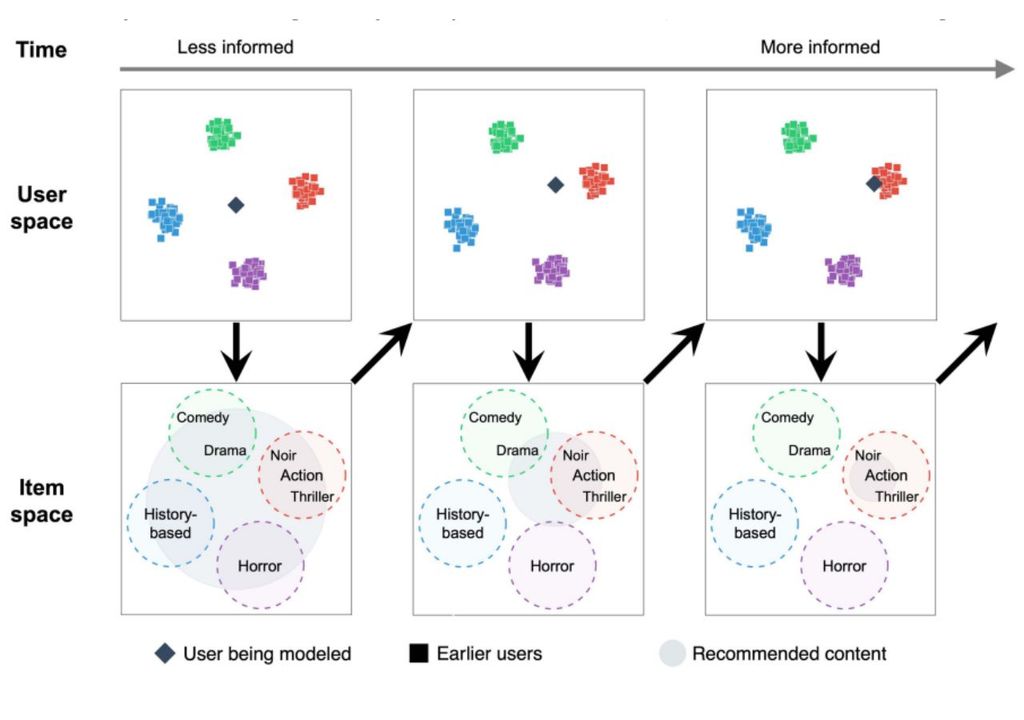

Imagina que decides explorar el cine de un país que desconoces completamente. Abres tu plataforma de streaming favorita y la primera película que eliges, es un Thriller de acción. A partir de ese momento, el algoritmo te bombardea con más thrillers de acción.

Semanas después, crees entender el cine de ese país, pero en realidad solo has visto una fracción mínima de lo que ofrece. Este escenario ilustra un problema inquietante que acaba de documentar un equipo de investigadores de la Universidad Estatal de Ohio: los algoritmos de personalización no solo filtran nuestra información, sino que distorsionan fundamentalmente cómo aprendemos y nos llenan de una confianza injustificada en conocimientos que nunca adquirimos realmente.

Cuando el algoritmo decide qué aprendes

El estudio, publicado en el Journal of Experimental Psychology, reunió a 346 participantes para una tarea de aprendizaje completamente nueva: clasificar criaturas alienígenas ficticias con seis características diferentes.

La clave del experimento era que nadie sabía nada previo sobre estos "aliens de cristal”, permitiendo a los investigadores observar cómo se forma el conocimiento desde cero. Los participantes se dividieron en dos grupos.

Los resultados fueron reveladores: quienes siguieron las recomendaciones algorítmicas exploraron mucho menos información, desarrollaron una comprensión distorsionada de las categorías y, lo más preocupante, se mostraron excesivamente confiados en respuestas equivocadas. "Estaban incluso más seguros cuando se equivocaban que cuando acertaban, lo cual es alarmante porque tenían menos conocimiento", explica Giwon Bahg, autor principal del estudio.

El peligro de las generalizaciones infundadas

Lo que hace especialmente peligroso este fenómeno es que las personas toman la información limitada proporcionada por los algoritmos y trazan conclusiones amplias sobre áreas que nunca han explorado realmente. "La gente pierde información cuando sigue un algoritmo, pero cree que lo poco que sabe se generaliza a otras características y otras partes del entorno que nunca han experimentado", señala Brandon Turner, coautor del estudio y profesor de psicología.

Esta tendencia tiene implicaciones profundas en la vida real. Si alguien aprende sobre política, ciencia o cultura, principalmente a través de contenido algorítmicamente curado, puede desarrollar una visión del mundo fundamentalmente sesgada sin siquiera darse cuenta.

El estudio desafía la creencia común de que los algoritmos solo amplifican prejuicios existentes. La investigación demuestra que incluso cuando comenzamos sin conocimiento previo sobre un tema, los algoritmos pueden crear sesgos inmediatamente y construir desde cero una comprensión distorsionada de la realidad.

¿Qué significa esto para niños y educación?

Las preocupaciones se intensifican cuando consideramos a niños y jóvenes aprendiendo sobre el mundo a través de plataformas digitales. "Si tienes un niño pequeño genuinamente tratando de aprender sobre el mundo, e interactúa con algoritmos online que priorizan que los usuarios consuman más contenido, ¿qué va a pasar?", cuestiona Turner.

La educación tradicionalmente ha valorado la exposición a perspectivas diversas y el pensamiento crítico. Sin embargo, los algoritmos operan bajo una lógica diferente: maximizar la atención manteniendo a los usuarios en zonas de confort informativo. Esta tensión entre aprendizaje genuino y consumo algorítmico plantea desafíos urgentes para educadores, padres y diseñadores de plataformas digitales.

Este estudio nos invita a reconsiderar nuestra relación con las plataformas personalizadas. No se trata de demonizar la tecnología, sino de reconocer que los algoritmos pueden funcionar como maestros invisibles que nos enseñan de manera sesgada sin que nos demos cuenta.

La próxima vez que sientas que comprendes bien un tema después de consumir contenido digital, pregúntate: ¿realmente exploré diferentes perspectivas, o solo seguí el camino que un algoritmo trazó para mí? La respuesta puede ser más inquietante de lo que imaginas.

Referencias de la noticia

- Giwon Bahg, Vladimir M. Sloutsky, Brandon M. Turner. Algorithmic personalization of information can cause inaccurate generalization and overconfidence. Journal of Experimental Psychology: General, 2025.

- Ohio State University. (2025, November 25). How personalized algorithms trick your brain into wrong answers. ScienceDaily.

No te pierdas la última hora de Meteored y disfruta de todos nuestros contenidos en Google Discover totalmente GRATIS

+ Seguir a Meteored