A un 'perro robot' se le han otorgado capacidades de percepción similares a las humanas

El robot WildFusion no solo tiene visión como la mayoría de los robots, sino que también puede sentir vibraciones, tacto y “estados corporales” para explorar el bosque, como un animal.

A veces es fácil pasar por alto lo mucho que nuestros sentidos hacen por nosotros. Nos permiten navegar por un mundo complejo, cada vez más variado en la naturaleza.

La audición, el olfato, el tacto y el equilibrio nos ayudan a navegar por el paisaje, ya sea en una carrera matutina o en una caminata por la montaña.

Mirar detalles que incluso nuestra mente consciente puede no percibir puede ayudarnos a orientarnos, como la copa de los árboles en el cielo o el cambio de sombra y color en la distancia que indica un nuevo terreno, o incluso la presencia de agua.

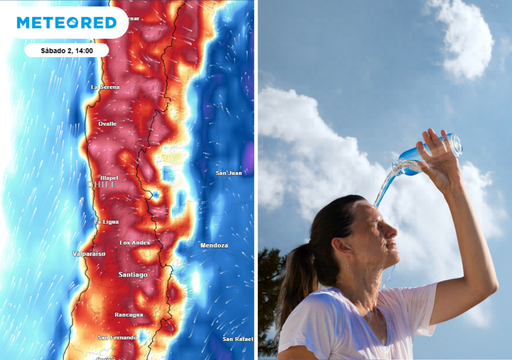

Sentir el musgo bajo nuestros pies o el crujido de las ramas nos habla no solo del cambio de terreno, sino también de nuestra propia estabilidad. Esto también se puede percibir a través del clima. El cambio de color del cielo o un cambio de temperatura nos advierten instintivamente de una posible tormenta. Una tormenta inminente advierte del peligro que se avecina.

Pero ¿acaso un robot es ajeno a estos detalles? Carecen de la capacidad sensorial de los animales o de los humanos. ¿O sí? Quizás sí, gracias a nuevas innovaciones. WildFusion muestra esa posibilidad.

Conoce WildFusion

Los robots han dependido durante mucho tiempo únicamente de datos visuales, como los obtenidos mediante cámaras o lidar, para poder moverse por el mundo.

La navegación multisensorial ha sido un desafío para los robots , particularmente en el bosque, que es como un reino de incertidumbre para los robots típicos que dependen de la tecnología de visión por cámara.

Were thrilled to share our new research WildFusion: Multimodal Implicit 3D Reconstructions in the Wild.

— Boyuan Chen (@Boyuan__Chen) October 13, 2024

Our robot doesnt just see with LiDAR and camerasit feels, hears, and learns using tactile sensors, IMU data, and contact microphones. Combining these signals creates pic.twitter.com/A2vmmJ192d

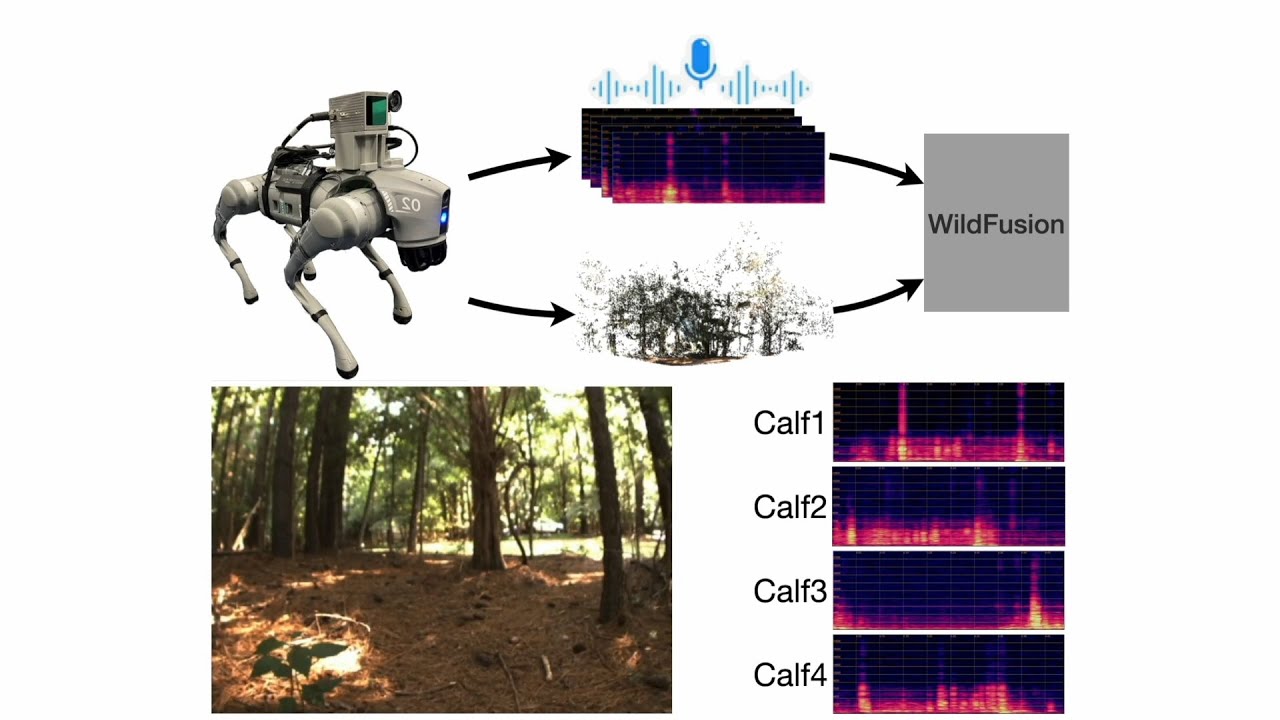

Los expertos de la Universidad de Duke han innovado y diseñado WildFusion, que aprovecha no solo la visión, sino también la vibración y el tacto para permitir que el robot detecte entornos exteriores complejos como lo hacen los humanos.

«WildFusion abre un nuevo capítulo en la navegación robótica y el mapeo 3D», afirmó Boyuan Chen, profesor adjunto de la Universidad de Duke . «Ayuda a los robots a operar con mayor confianza en entornos desestructurados e impredecibles como bosques, zonas de desastre y terrenos todo terreno».

"Los robots típicos dependen en gran medida de la visión o del LiDAR únicamente, que a menudo fallan si no tienen rutas claras ni puntos de referencia predecibles", añadió Yanbaihui Liu, el autor principal del estudio y estudiante de doctorado en el laboratorio de Chen.

Incluso los métodos avanzados de mapeo 3D tienen dificultades para reconstruir un mapa continuo cuando los datos de los sensores son escasos, ruidosos o incompletos, un problema frecuente en entornos exteriores desestructurados. Ese es precisamente el desafío que WildFusion se diseñó para resolver.

¿Cómo es WildFusion?

En cierto modo, el robot WildFusion se asemeja a un perro, ya que está sobre cuatro patas , es decir, es cuadrúpedo. Utiliza múltiples modalidades de detección: sensores inerciales, sensores táctiles, micrófono de contacto, LiDAR y una cámara RGB.

Los micrófonos de contacto pueden detectar la variedad de vibraciones en cada paso de sus patas. Incluso pequeñas diferencias, como el crujido de las hojas secas y el aplastamiento del barro, pueden percibirse. Estos sensores táctiles pueden detectar la fuerza aplicada a cada pie. Esto ayuda al robot a detectar la estabilidad o superficies resbaladizas, todo en tiempo real.

Los datos de aceleración revelan cuánto se tambalea o rueda el robot sobre terreno irregular. En el corazón de WildFusion se encuentra un modelo de aprendizaje profundo que integra todas estas capacidades sensoriales, de forma similar a como lo hace el cerebro humano.

Esto permite al robot realizar movimientos fluidos sobre terrenos complejos gracias a decisiones más inteligentes que serían consideradas "intuitivas" para un humano.

“Piénsalo como resolver un rompecabezas al que le faltan algunas piezas, pero que intuitivamente te permite visualizar la imagen completa”, explicó Chen. “El enfoque multimodal de WildFusion permite al robot completar los espacios en blanco cuando los datos de los sensores son escasos o con ruido, de forma similar a lo que hacen los humanos”.

Mecánica interna

El robot fue probado en un parque de Carolina del Norte cerca del campus de la Universidad de Duke, lo que implicó atravesar terreno forestal, pastizales y grava.

"Observar al robot navegar con seguridad por el terreno fue increíblemente gratificante", reflexionó Liu. "Estas pruebas reales demostraron la notable capacidad de WildFusion para predecir con precisión la transitabilidad, lo que mejoró significativamente la toma de decisiones del robot sobre rutas seguras en terrenos difíciles".

Potencial de defensa

El sistema puede desarrollarse aún más con más sensores, como los que detectan la humedad, para que un robot comprenda y se adapte a entornos complejos. Esto permitirá a WildFusion explorar más allá del bosque, incluso en sitios con infraestructura remota, zonas de desastre y áreas de exploración autónoma.

“Uno de los principales retos de la robótica actual es desarrollar sistemas que no solo funcionen bien en el laboratorio, sino que también funcionen de forma fiable en entornos reales”, afirmó Chen. “Eso significa robots que puedan adaptarse, tomar decisiones y seguir avanzando incluso en situaciones desastrosas”.

Actualmente, parece existir un interés real y potencial en estas tecnologías robóticas para la defensa. Este trabajo fue financiado por la Agencia de Proyectos de Investigación Avanzada de Defensa, Laboratorio de Investigación del Ejército.

El trabajo se presentará en la prestigiosa Conferencia Internacional IEEE sobre Robótica y Automatización (ICRA 2025), que se llevará a cabo hasta el 23 de mayo de 2025 en Atlanta, Georgia.

Fuente de la noticia

Dotando a los robots de percepción similar a la humana para navegar por terrenos difíciles / WildFusion: Reconstrucciones 3D implícitas multimodales en la naturaleza. Universidad de Duke. Informes y actas. Mayo de 2025.

WildFusion: Reconstrucciones 3D implícitas multimodales en la naturaleza. Conferencia Internacional sobre Robótica y Automatización (ICRA 2025). Avance de la conferencia. Septiembre de 2024.

No te pierdas la última hora de Meteored y disfruta de todos nuestros contenidos en Google Discover totalmente GRATIS

+ Seguir a Meteored